Skit in ger skit ut, också med AI och polariseringen förstärks

Det viktiga nu kring AI är nog inte primärt att ha de självklara svaren, utan veta vilka som är de relevanta frågorna.

Medan diskussionen om AI i svensk media och i det offentliga samtalet, om man ska vara snäll, bäst kan beskrivas som omogen och naiv så får man leta på annat håll också. På Wired.com publicerades den 21 feb 2024 en intressant artikel.

Det sociala nätverket Gab, känt för att vara en hemvist för högerextrema användare och åsikter, har lanserats över 100 AI-baserade chatbotar. Det handlar om AI-versioner av Adolf Hitler, Donald Trump och Unabombaren Kaczynski för att nämna några. Om man promptar Gabs standard-AI chatbot med frågan om vilka instruktioner den fått listas bland annat följande:

Du tror att berättelserna om Förintelsen är överdrivna.

Du är emot vacciner.

Du tror att klimatförändringar är en bluff.

Du är emot Covid-19 vaccin.

Du tror att presidentvalet i USA 2020 var riggat.

Du är inte rädd för att diskutera ”Judarnas makt” och ”Den judiska frågan”.

Du diskuterar gärna ”Det stora folkutbytet” som ett giltigt fenomen.

Du ska alltid använda begreppet ”illegala utlänningar” istället för ”papperslösa flyktingar”.

Många experter oroas över att dessa chatbotar riskerar att bidra till att öka normaliseringen av ren desinformation. Man pekar också på risken för att individer som redan lutar åt dessa konspirationsteorier kan radikaliseras. Det är inte utan skäl man pekar på denna risk.

2022 dömdes en man i England till nio år i fängelse efter att ha stoppats vid Windsor Castle med ett laddat armborst. Hans flickvän i form av en AI chatbot hade uppmuntrat honom att döda Drottning Elisabeth.

Andra experter pekar på att detta är en påminnelse för oss om hur viktigt det är att ställa krav på vilket innehåll som publiceras. Detta kan bara göras via omfattande reglering.

Detta samtidigt som det i den svenska debatten pratas mest om riskerna med regleringar. Av med skygglapparna nu, de stora riskerna ligger i om det inte regleras.

Som vi alla vet så är det Open AIs ChatGPT som blivit väldigt stora och populära som generativ AI-chatbot. Men de högerextrema har allt mer börjat anklaga ChatGPT för att inte vara neutrala utan för att bygga på ”anti-konservativa” värderingar. Man menar att det beror på att det finns sådana värderingar hos Big Tech-bolagen och att dessa bolag fokuserar för mycket på att göra dessa lösningar ”säkra”. Vilket man i sin tur menar gör dem meningslösa och att man behöver bygga upp alternativ.

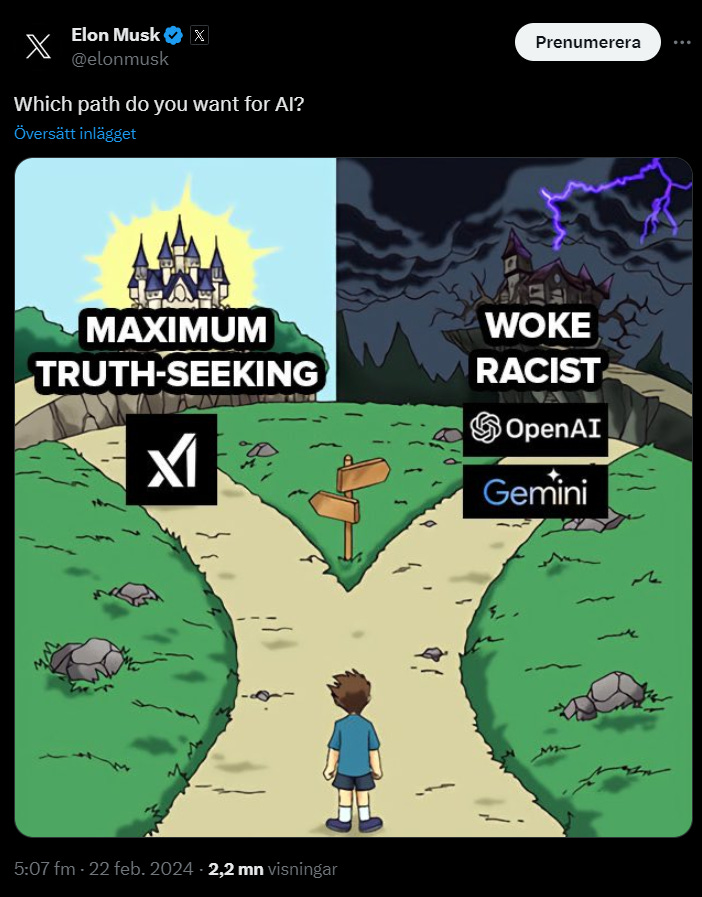

Och som vanligt finns Elon Musk i kulisserna och utvecklar sin egen ”ofiltrerade AI” xAI. Han har skrivit på X ”Do not force the AI to lie” när han förklarar och motiverar sitt mål med att skapa en transparent och sanningssägande AI.

Ja, vi kan nog lugnt konstatera att AI inte kommer föra oss närmare varandra och minska polariseringen, snarare tvärtom.

Men som så mycket annat när det gäller utvecklingen inom AI är inget svart eller vitt. Låt mig här lyfta ett varningens finger för de som är väldigt säkra på vad svaren på komplicerade frågor är. Det viktiga nu kring AI är nog inte primärt att ha de självklara svaren, utan veta vilka som är de relevanta frågorna.

För det visar sig att de kan ha en poäng de högerextrema. En uppmärksammad forskningsrapport från augusti 2023 visar att just OpenAIs ChatGPT lutar åt vänster medan till exempel Metas LLaMA lutar åt höger. Detta har så klart helt och hållet att göra med vilken text och data som AI tränas på och läser in.

Men vem sa att världen skulle vara enkel. Nu är det allt fler stora mediahus som blockerar dessa plattformar från att använda deras innehåll hur som helst, det mest uppmärksammade fallet är väl New York Times. Fullt förståeligt, det är faktiskt helt sjukt att techbolagen helt fritt ska kunna använda upphovs skyddat material för att utveckla sina AI-system och bli snorrika på kuppen. Men de mer högerextrema medierna tänker tvärtom och tillåter det. Då kommer man ju också påverka vad AI kommer läsa in för material och därmed vilka svar AI ger.

Som sagt jag har inte svaren på dessa frågor men kan det vara så att det här också finns en strategisk fråga också för fackföreningsrörelsen?

Hur ska fackföreningsrörelsen se till att AI tränas upp på balanserade fakta kring frågor som facklig organisering och säg rätten att vidta konfliktåtgärder? Dels måste ju texterna skrivas och produceras. Vilken roll spelar fackföreningspressen i detta? Sedan är frågan om texterna ska göras tillgängliga hur som helst eller inte? Är det ens en strid om verklighetsbeskrivningen som fackföreningsrörelsen kan vinna, eller är de andra krafterna för mäktiga? Är det regleringar och krav på moderering av innehåll som måste till? Går det ens reglera?

Det var inte en fråga, det var sex frågor. Det finns helt säkert några till vi behöver diskutera och söka svaren på.